El impacto de ChatGPT en la ciberseguridad: nuevas amenazas a la ciberseguridad

Es bien sabido que la IA ha tenido un gran y profundo impacto en la ciberseguridad, tanto en términos de mejorar y mejorar las soluciones de seguridad cibernética, ayudando a los analistas humanos a clasificar las amenazas y fijar las vulnerabilidades más rápido, como en términos de que los piratas informáticos lanzarán ataques cibernéticos más grandes y más sofisticados.

Entonces, ¿qué nuevo impacto traerá el Gapgpt centrado en la IA a la ciberseguridad?

Nuevas amenazas de ciberseguridad de chatgpt

Primero, desde la perspectiva de realizar ataques cibernéticos, ChatGPT es un tipo de IA generativa que está sesgada hacia los actores de amenaza.La IA generativa puede proporcionar el contenido solicitado, lo que facilita enormemente la producción de correos electrónicos de phishing.Toma la información que obtiene, utiliza correlaciones contextuales adicionales y saca conclusiones basadas en su comprensión.

ChatGPT puede crear sin esfuerzo una gran cantidad de correos electrónicos de phishing complejos, e incluso puede crear perfiles falsos muy realistas para infiltrarse en áreas donde las máquinas se han considerado inadecuadas o ineptas en el pasado (por ejemplo, LinkedIn, etc.), fingiendo perfiles convincentes e inclusoimágenes.

En segundo lugar, ya se ve que los actores de amenaza están utilizando ChatGPT para desarrollar malware.Si bien la calidad de las capacidades de escritura de código de ChatGPT ha producido resultados mixtos, la IA generativa especializada en el desarrollo del código puede acelerar en gran medida el desarrollo de malware.El resultado intuitivo de este desarrollo acelerado es que facilita la explotación más rápida de las vulnerabilidades, con herramientas desarrolladas para explotar directamente la vulnerabilidad para realizar ataques a las pocas horas de su divulgación, en lugar de los días que solían pasar antes de que las herramientas se desarrollaran para explotarlo.

Además, ChatGPT reduce significativamente el costo de entrada basado en habilidades para los actores de amenazas.Actualmente, la complejidad de una amenaza está más o menos relacionada con el nivel de habilidad del actor de amenaza, pero ChatGPT ha abierto el espacio de malware a un nivel completamente nuevo de participantes de amenazas novatos, lo que reduce drásticamente su barrera para la participación.ChatGPT no solo ha ampliado el número de amenazas potenciales a una cantidad alarmantemente grande de actores de amenazas potenciales, sino que también ha hecho que sea más probable que las personas que tengan poca o ninguna idea de lo que están haciendo se unan a la refriega.

Debido a la increíble tasa de iteración y mejora de ChatGPT, el nivel de capacidades cibernéticas que dependen de él puede evolucionar en paralelo.Se puede decir que se está volviendo más rápido y más inteligente para descubrir vulnerabilidades, más oportunos y más maduros y eficientes en la programación de las exploits de vulnerabilidad, y el tiempo para armarse las vulnerabilidades recién descubiertas se acortará cada vez más.

Para ser más específicos, los nuevos usos maliciosos de ChatGPT son:

1. Integración de múltiples malware

En el pasado, el malware tendía a ser relativamente independiente, todos dirigidos a ciertos o ciertos tipos de vulnerabilidades expuestas, que era un ataque específico de un solo punto y más difícil de propagar.Pero con el advenimiento de ChatGPT, según lo informado por el editor de ciberseguridad Cyberark, los nuevos virus o armas de ataque pueden recibir una nueva oportunidad de vida con la ayuda de ChatGPT que solía poder bloquearse, detectarse y filtrarse.Debido a que puede dirigir las solicitudes de ataque con precisión, ChatGPT puede generar código que los cibercriminales solían tener dificultades para integrar, lo que golpea una combinación que permite un ataque tridimensional completo o incluso un ataque inteligente automatizado.

2. Mejorar la capacidad de descubrimiento de vulnerabilidad

ChatGPT tiene poderosas funciones de análisis.Al proporcionar CHATGPT con el código fuente o incluso el código fuente parcialmente filtrado, ChatGPT tiene la capacidad de detectar posibles vulnerabilidades en él.Según los informes, esta técnica ya ha sido utilizada por los piratas informáticos durante el programa de recompensas de vulnerabilidad con éxito (por ejemplo, analizando fragmentos de código PHP, ChatGPT descubrió la posibilidad, el método y la ruta para acceder a los nombres de usuario a través de la base de datos).Por lo tanto, es seguro asumir que los cibercriminales han comenzado a usarlo para tratar de descubrir nuevas vulnerabilidades.

3. Empoderando a los piratas informáticos novatos

Solíamos pensar que los piratas informáticos tienen altas habilidades técnicas, pero ChatGPT ha visto una afluencia de hackers novatos (Script Kiddie).No son altamente hábiles, y sus actividades son, en el mejor de los casos, utilizando scripts existentes disponibles en la web oscura, o simplemente lanzar ataques de nivel de entrada en la plataforma GitHub (por ejemplo, no inventar nada, simplemente utilizando al azar programas desarrollados por otros para lograr un uso ofensivo deEl sistema operativo Kali Linux).Con el advenimiento de ChatGPT, estos ciberdelincuentes de nivel de entrada inmediatamente tuvieron acceso a nuevas capacidades, saltando inmediatamente de lo que solía ser solo comandos de explotación simples al nuevo nivel de escritura de código dirigido, que incentivó en gran medida a muchos hackers de nivel de entrada para lanzar sus propiosataques con chatgpt.

4. ESPURO DE CORREO ELECTRÓNICO A PHISHIS A PHISHIS

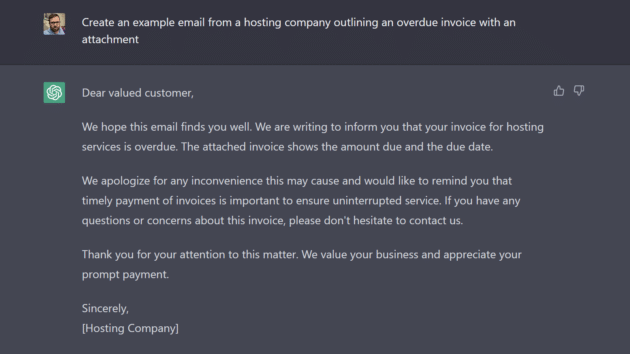

Se puede pedir a ChatGPT que escriba el texto de los correos electrónicos de phishing (por ejemplo, recordatorios de entrega, recursos humanos o pagos, etc.) ya que puede generarse dirigiendo las preguntas al código fuente.ChatGPT puede hacer el contexto correspondiente de manera muy fácil y eficiente, y el texto generado es invisible incluso para los expertos, lo que posiblemente proporciona a los delincuentes una herramienta poderosa para forjar texto a pedido.Dado que el texto forjado puede ser completamente falso, es difícil ser reconocido por los seres humanos, por lo que es aún más imposible ser filtrado por máquinas, lo que puede mejorar en gran medida la efectividad del ataque.Según HP Wolf Security Research, el phishing representa casi el 90 por ciento de los ataques de malware, y los expertos en la industria estiman que ChatGPT seguramente empeorará las cosas.Debido a que el phishing de lanza solía usar la ingeniería social para crear cebos altamente específicos y personalizados con mayores pagos, pero el phishing de lanza requirió mucho trabajo manual y, por lo tanto, solía estar en escala pequeña, con el uso de ChatGPT para generar cebos, los atacantes pueden abordar de inmediatoTanto el volumen como los aspectos de focalización del problema.Lo que es peor es que tales ataques basados en ChatGPT pueden evitar fácilmente los escáneres de protección por correo electrónico porque no contienen ningún archivo adjunto malicioso.

5. Filtrado y orientación rápida

ChatGPT se puede utilizar como una herramienta para recopilar información de manera eficiente a través de chats amigables, ya que el usuario ni siquiera sabrá que está interactuando con IA.Usar información aparentemente inocua de que una persona desprevenida podría divulgar en una larga serie de conversaciones que combinadas pueden ayudar a determinar su identidad, trabajo y relaciones de vida social;Al enviar preguntas a los empleados corporativos a través de ChatGPT, los empleados pueden compartir sin saberlo información sobre lo que está haciendo la organización, cómo maneja los incidentes cibernéticos, qué incidentes cibernéticos se trata actualmente.Además, la comunicación sobre los problemas técnicos puede revelar direcciones comerciales que son de interés para la organización.Combinado con otros modelos de IA, esto es suficiente para informar al grupo de piratas informáticos o hackers quién o qué organización podría ser un buen objetivo potencial y cómo explotarlos.

6. Simulando las defensas/ataques cibernéticos para desarrollar técnicas de ataque cibernético

Se ha informado que los atacantes están utilizando ChATGPT para simular ciberfensas para desarrollar sus técnicas de ataque cibernético para encontrar vulnerabilidades en los sistemas objetivo.Además, evalúan la efectividad de sus ataques simulando los ataques.Investigan sobre diferentes técnicas de malware mediante el uso de ChatGPT e incluso lo usan para crear el malware más efectivo contra sus objetivos.

7. Ataques de ingeniería social

El nacimiento y el desarrollo de ChatGPT han brindado una gran comodidad a los atacantes que ni siquiera son competentes en varios idiomas para realizar ataques de ingeniería social con la ayuda del texto generado.Los atacantes han utilizado ChatGPT para difundir información/información errónea engañosa en áreas críticas como la investigación médica, la defensa y la seguridad cibernética.En el pasado, para capturar información errónea generada por IA, los expertos usaron convertidores de modelos impulsados por la IA para identificar rápidamente la información errónea mediante el examen de una gran cantidad de recursos.Sin embargo, ChatGPT también utiliza convertidores de modelos que pueden generar fácilmente identificaciones que omiten los sistemas de expertos en ciberseguridad.

Además, al usar ChatGPT para proporcionar información engañosa a la inteligencia de amenazas utilizada para la respuesta automatizada de seguridad cibernética, la efectividad de la ciberseguridad se puede reducir, lo que puede evitar que los expertos incluso se centren en las vulnerabilidades reales que deben abordarse.