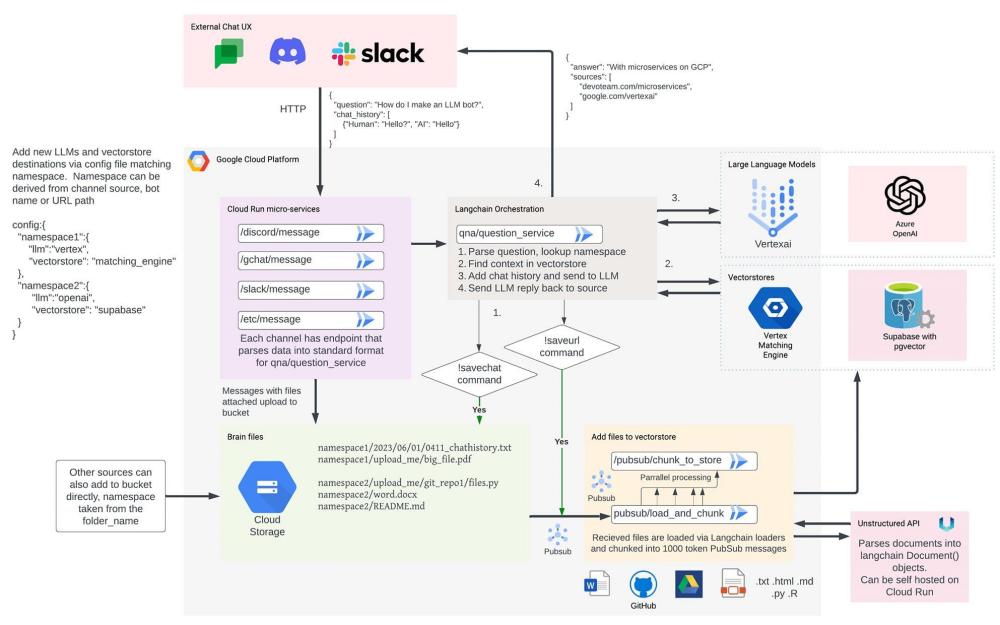

Arquitectura de datos para investigar LLMOPS en Google Cloud Micro-Services

Aquí hay algunas arquitecturas de datos que se muestran, explore la investigación de LLMOPS en los micro-servicios de Google Cloud con Langchainai como catalizador.

Esto es, por supuesto, con la asistencia de codificación de LLM, por lo que es mucho más rápido prototipo.Todo esto se ejecuta en Google Cloud Run y PubSub, escamas entre Zero y mil millones, y puede cambiar entre LLMS y Vectorstores muy fácilmente.